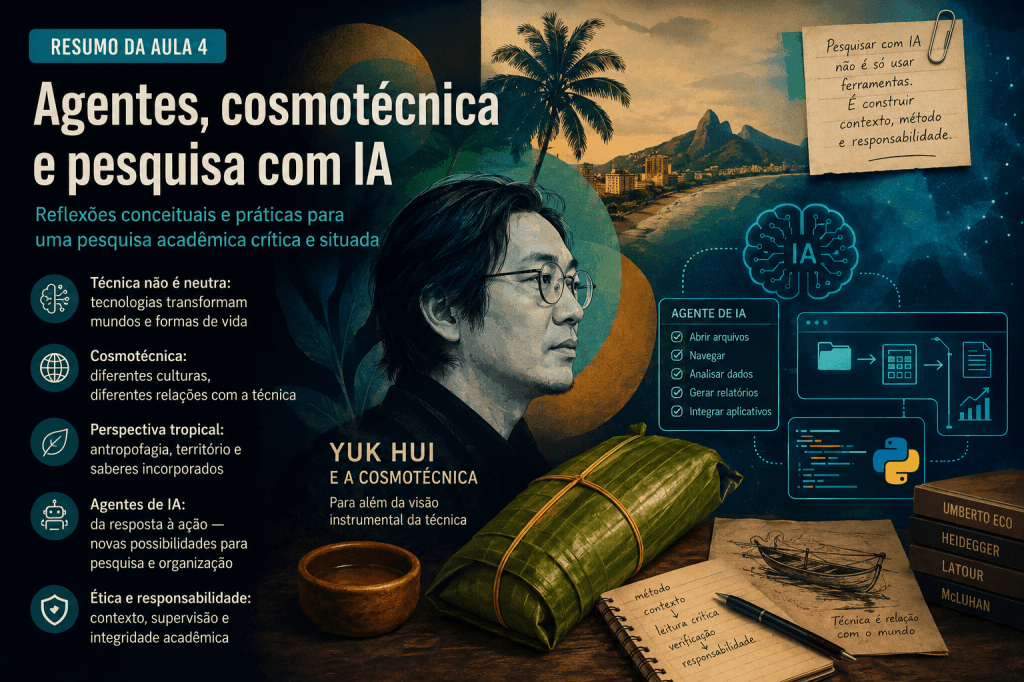

A última aula funcionou como um fechamento conceitual e prático do curso. Depois das aulas anteriores, centradas na construção de contexto, na ecologia das contas/projetos e na coleitura com IA, este encontro deslocou a discussão para dois eixos principais: primeiro, uma reflexão filosófica sobre técnica, tecnologia e cosmotécnica; depois, uma introdução prática ao uso de agentes de IA em tarefas de pesquisa e organização acadêmica. A aula também teve um caráter de balanço: retomou Umberto Eco, discutiu integridade acadêmica, abordou o impacto das IAs no trabalho e abriu caminhos para pensar uma relação mais situada, tropical e crítica com essas tecnologias.

1. Abertura: encerramento do curso e continuidade do grupo

A aula começou com uma conversa informal sobre a experiência do curso, a chegada dos participantes e algumas dificuldades de acesso à plataforma. Também apareceu a ideia de manter o grupo de WhatsApp como espaço de continuidade, troca de textos, sugestões e acompanhamento de novas turmas. Foi destacada a importância de manter uma turma pequena, com cerca de 20 participantes, porque isso permite conversa, escuta das demandas e acompanhamento mais próximo. Acima disso, o curso tenderia a virar palestra, perdendo parte do caráter dialógico.

Também houve uma breve conversa sobre plataformas de inscrição, como Sympla e Even3, mostrando que a própria organização do curso já fazia parte de uma ecologia técnica: inscrição, comunicação, links de acesso, grupos, gravações, resumos e materiais complementares.

2. Retomada de Umberto Eco: pesquisar é aprender um método

Um dos pontos de partida conceituais da aula foi a releitura de Como se faz uma tese, de Umberto Eco. A obra foi situada no contexto da universidade italiana dos anos 1970, especialmente no momento em que camadas populares começavam a entrar mais fortemente na universidade. Eco escrevia para estudantes que muitas vezes não tinham tempo livre, recursos para comprar livros caros, familiaridade com bibliotecas ou hábito consolidado de pesquisa.

Nesse contexto, a tese de Eco era apresentada como uma aprendizagem de método. Pesquisar significava aprender a delimitar um tema, identificar fontes primárias e secundárias, fazer fichamentos, organizar argumentos, comparar materiais e construir um percurso intelectual. A aula conectou esse ponto ao presente: mesmo com a digitalização e agora com as IAs, alguns elementos permanecem centrais. A pesquisa continua exigindo método, delimitação, leitura, comparação, crítica e responsabilidade intelectual.

A diferença é que, na era da IA, esse método passa a ser reorganizado por novas mediações. A questão deixa de ser apenas “como fazer uma tese?” e passa a incluir: como construir contexto com IA? Como verificar fontes? Como usar modelos sem delegar a responsabilidade intelectual? Como diferenciar apoio, coescrita, automação e autoria?

3. Para além da visão instrumental da tecnologia

A aula insistiu em um ponto fundamental: não basta pensar a IA como ferramenta. Reduzir uma tecnologia ao seu uso instrumental — “eu uso para fazer X” — impede perceber que toda técnica também transforma quem a utiliza. Essa reflexão foi articulada com autores como Simondon, Latour, McLuhan e Yuk Hui.

O exemplo da escrita foi usado para mostrar isso. A escrita é uma tecnologia tão naturalizada que muitas vezes esquecemos sua dimensão técnica. No entanto, ela reorganizou profundamente a memória, a administração, o calendário, as leis, a ciência, as artes, as formas de documentação e até a própria experiência do tempo. A escrita não apenas serviu ao pensamento; ela transformou o pensamento.

A aula trouxe também exemplos de pessoas que não se comunicam pela escrita, mas pelo áudio no WhatsApp. Esse ponto serviu para mostrar que diferentes tecnologias criam diferentes mundos de ação. O caso do encanador mencionado na aula ilustra um tipo de saber prático, incorporado, não necessariamente formalizado por escrito, mas altamente sofisticado. Isso permitiu conectar a discussão sobre IA ao tema mais amplo dos saberes técnicos, das práticas situadas e dos conhecimentos que não cabem facilmente nos modelos formais da academia.

4. IA, trabalho e precarização

A discussão sobre técnica levou naturalmente ao tema do impacto da IA no trabalho. Um dos participantes chamou atenção para o risco de o discurso “a IA vai tirar empregos” ser usado como ameaça para reduzir salários, intensificar a precarização e naturalizar relações de trabalho mais desiguais. Também foi lembrado que existe trabalho humano invisibilizado por trás do treinamento e da moderação de sistemas de IA.

A resposta da aula buscou uma posição intermediária: é inegável que algumas atividades serão transformadas, automatizadas ou reorganizadas, mas isso não significa aceitar passivamente o discurso empresarial do inevitável. O exemplo dos digitadores, citado a partir da experiência do pai de André no contexto da computação por cartão perfurado e do Serpro, mostrou que mudanças técnicas podem levar à requalificação e à redistribuição de funções, não necessariamente à demissão direta.

A discussão também passou pelo setor de serviços, supermercados, caixas automáticos, estoquistas, robôs e carrinhos com leitores. A observação sobre Salvador foi interessante: mesmo quando há caixas de autoatendimento, muitas pessoas não os utilizam, especialmente quando há produtos que precisam ser pesados ou quando o processo exige mediação humana. Isso reforçou a ideia de que a adoção tecnológica nunca é apenas técnica; ela depende de hábitos, confiança, infraestrutura, cultura local e desenho social do serviço.

5. Yuk Hui e a pergunta pela cosmotécnica

O eixo filosófico principal da aula foi a apresentação de Yuk Hui. A partir dele, foi feita uma crítica à ideia de que a técnica é universal, neutra e funcional. A pergunta central apresentada foi: todas as culturas pensam a técnica do mesmo modo?

A resposta de Yuk Hui é não. A modernidade ocidental tende a tratar a tecnologia como uma promessa universal de mundo, como se todos os povos devessem seguir o mesmo caminho de modernização. Essa visão reduz diferentes técnicas a uma única categoria chamada “tecnologia” e tende a organizar o planeta como recurso disponível para o desenvolvimento técnico.

A aula aproximou esse debate de Heidegger, especialmente da ideia de que a tecnologia moderna não é apenas um conjunto de instrumentos, mas um modo de revelar o mundo. Nessa perspectiva, a natureza aparece como estoque, reserva, recurso explorável. O petróleo, os minérios, a energia, a água e os territórios passam a ser compreendidos como insumos para alimentar sistemas técnicos.

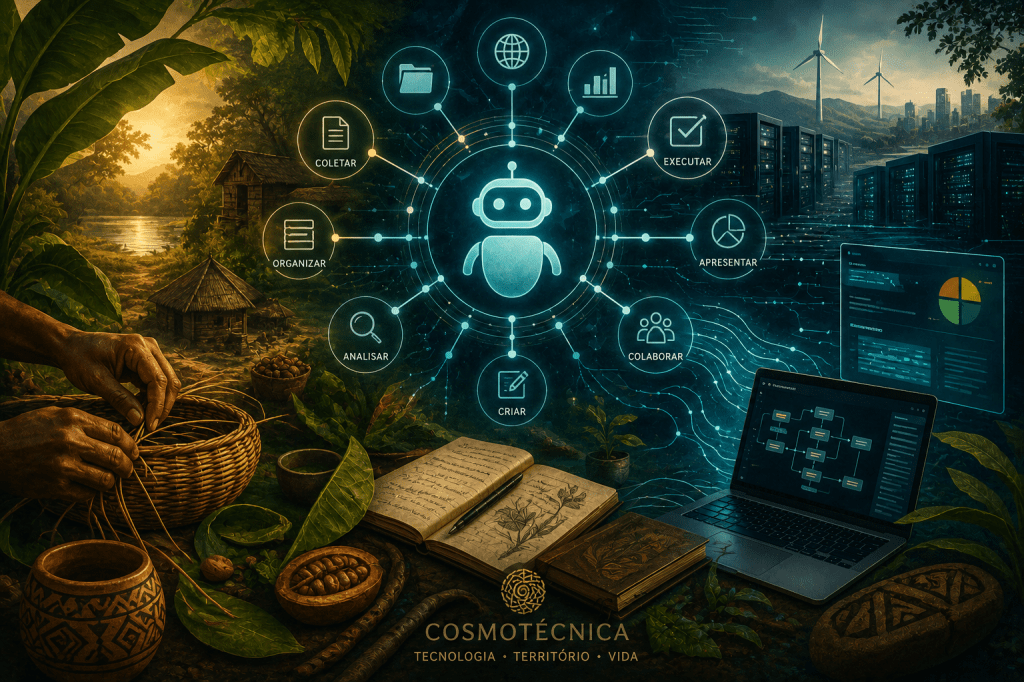

Yuk Hui aceita a força dessa crítica, mas pergunta se ela vale para todas as tradições culturais. Para ele, Heidegger ainda pensa a técnica a partir de uma história ocidental. A cosmotécnica, então, seria a tentativa de compreender como diferentes culturas articulam técnica, cosmos, moral, território, natureza e formas de vida.

6. Da técnica neutra à tecnodiversidade

A aula contrastou duas formas de compreender a técnica. Na visão instrumental, a técnica é meio para um fim, neutra, universal e substituível. Na visão cosmotécnica, a técnica expressa uma forma de vida. Uma rede de pesca, uma canoa, uma casa, uma folha de bananeira usada para embalar alimento ou um algoritmo não são apenas meios; eles organizam relações entre humanos, não humanos, território e mundo.

O exemplo do abará embalado na folha de bananeira foi usado como imagem regional de uma solução técnica não separada do ambiente. Ao contrário do plástico, a folha de bananeira integra alimento, território, cultura e sustentabilidade. Esse exemplo permitiu pensar uma técnica menos voraz, menos extrativa e mais incorporada a uma forma de vida.

A aula também aproximou essa discussão de Nego Bispo, especialmente da crítica à ideia de “desenvolvimento” como afastamento do envolvimento. Em vez de desenvolver no sentido de separar, seria preciso pensar formas de envolvimento, confluência e relação.

Outro ponto importante foi a comparação entre tradições culturais. Na tradição grega, a técnica aparece muitas vezes vinculada ao mito de Prometeu: roubo do fogo, transgressão, domínio e emancipação. Já em outras tradições, como a chinesa, a técnica pode ser pensada como continuidade entre cosmos, comunidade, corpo e prática. O exemplo da medicina chinesa, com os conceitos de Tao e Qi, serviu para mostrar como uma técnica pode não ser compreendida adequadamente quando traduzida apenas pelos parâmetros da ciência ocidental.

7. Cosmotécnica tropical, antropofagia e Gilberto Gil

A partir de Yuk Hui, a aula propôs pensar uma possível “cosmotécnica tropical”. A pergunta era: como o Brasil poderia se relacionar com as tecnologias digitais e com a IA sem apenas importar modelos prontos, categorias externas e imaginários técnicos vindos dos centros de poder?

A hipótese apresentada foi aproximar esse debate da antropofagia modernista: a capacidade de devorar influências externas, digeri-las e devolvê-las com outro sabor, outro ritmo e outro sentido. Essa lógica atravessaria a cultura brasileira em várias áreas: modernismo, bossa nova, cinema novo, música popular, samba, tropicalismo, funk e cultura digital.

Gilberto Gil apareceu como uma figura importante nesse percurso. Desde “Cérebro Eletrônico” até sua atuação como ministro da Cultura, Gil teria elaborado uma relação singular com a técnica, a cibernética e a cultura digital. Em vez de separar tecnologia e cultura, sua trajetória ajudaria a pensar um modo brasileiro, híbrido, musical, político e antropofágico de lidar com o digital.

Essa parte da aula foi importante porque deslocou a pergunta sobre IA. Em vez de apenas perguntar “como usar melhor a IA?”, a questão passa a ser: que relação queremos construir com essas tecnologias? Que mundo elas ajudam a compor? Que práticas, saberes e territórios elas podem fortalecer ou enfraquecer?

8. Discussão com a turma: técnica, território e saberes tradicionais

Na conversa com os participantes, surgiram exemplos que reforçaram a importância de pensar técnica e território de forma integrada. Um dos comentários retomou a experiência com trabalhadores da construção civil que não respondiam mensagens escritas, mas respondiam bem por áudio. Isso mostrou novamente que a tecnologia só funciona dentro de um contexto social, cultural e comunicacional.

Também apareceu o exemplo de técnicas tradicionais de construção no Maranhão, substituídas por modelos importados de pousadas e edifícios que não se adaptam bem ao clima local, exigindo ar-condicionado e aumentando o consumo energético. Esse exemplo ilustrou como uma técnica considerada “moderna” pode apagar saberes locais mais adequados ao território.

A discussão passou ainda por alimentação, saúde, plantas, chás, saberes populares e alimentos ultraprocessados. A IA foi pensada, nesse ponto, não apenas como ameaça, mas também como possível aliada para analisar hábitos alimentares, rótulos, composições nutricionais e práticas de consumo, desde que usada dentro de bons contextos e com critérios críticos.

9. Impacto ambiental das IAs e do ecossistema digital

Outro ponto importante foi a discussão sobre impacto ambiental. A aula reconheceu a importância do debate sobre água, energia e data centers, mas chamou atenção para o risco de tratar a IA isoladamente, como se fosse a única responsável por impactos ecológicos do mundo digital.

Foi lembrado que streaming, redes sociais, bancos, serviços de nuvem, plataformas digitais e outros sistemas também dependem de data centers. Além disso, o uso de água por grandes sistemas agroindustriais e industriais é muito maior do que o dos data centers. Isso não diminui a necessidade de discutir o impacto das IAs, mas ajuda a evitar uma crítica seletiva ou desproporcional.

O ponto central foi: a crítica ambiental à IA é necessária, mas precisa ser situada em uma crítica mais ampla à nossa ecologia técnica, energética, alimentar, produtiva e digital.

10. Introdução aos agentes de IA

A segunda grande parte da aula foi dedicada aos agentes de IA. A apresentação começou com cautela: os agentes ainda estão em fase inicial, apresentam riscos, exigem supervisão e podem causar problemas quando recebem permissões amplas demais. Mesmo assim, apontam para uma transformação profunda da relação com computadores.

A diferença básica apresentada foi: um chatbot responde; um agente executa. Ele pode abrir aplicativos, navegar por páginas, acessar arquivos autorizados, clicar, baixar documentos, operar planilhas, acionar ferramentas e realizar sequências de tarefas.

Foi mostrado o caso da integração entre ChatGPT e Gamma. A partir da área de configurações e aplicativos, é possível conectar serviços externos. Uma vez conectado ao Gamma, o ChatGPT pode abrir o aplicativo dentro da própria interface e executar tarefas, como criar slides com base em um projeto ou contexto já preparado. No exemplo da aula, isso foi usado para gerar uma apresentação sobre cosmotécnica e Yuk Hui, com melhor redução de texto por tela.

11. Demonstração prática: agente, Drive, planilhas e Python

A aula apresentou uma gravação de tela de um experimento com agente. O agente recebeu a tarefa de abrir uma pasta no Google Drive, acessar arquivos, baixar dados para um ambiente virtual, abrir terminal, usar Python, analisar planilhas, gerar documentos e produzir uma visualização gráfica.

Esse exemplo foi conectado diretamente à pesquisa acadêmica. Uma pasta no Drive poderia conter artigos, entrevistas, transcrições, planilhas de questionários, relatórios ou documentos administrativos. O agente poderia abrir cada arquivo, extrair informações, produzir resumos, organizar tabelas, gerar gráficos ou consolidar dados.

A ideia central foi mostrar que, em breve, parte do trabalho de pesquisa poderá ser feita por meio de comandos em linguagem natural que acionam sequências de ações em diferentes aplicativos. Isso não elimina a revisão humana; pelo contrário, aumenta a necessidade de supervisão, validação e clareza metodológica.

12. Cuidados de segurança: contas secundárias, permissões e isolamento

A aula insistiu bastante nos riscos. Para testar agentes, André explicou que criou uma sessão separada no Linux, sem acesso às contas pessoais, justamente para evitar que um agente tivesse poderes indevidos sobre arquivos, e-mails ou dados sensíveis.

Foram mencionados riscos como agentes apagarem arquivos, mexerem em e-mails, executarem ações não desejadas ou consumirem créditos de API. Também foi explicado que, quando um agente roda no computador, ele precisa se comunicar com um modelo de linguagem. O “corpo” do agente pode estar na máquina, mas o “cérebro” muitas vezes está na nuvem, sendo pago por tokens ou operações.

A recomendação implícita da aula foi: testar agentes em ambientes controlados, com contas secundárias, pastas específicas, permissões limitadas e supervisão constante. Em tarefas simples e repetitivas, eles podem ser úteis; em ações sensíveis, ainda exigem extremo cuidado.

13. Para que servem agentes na pesquisa?

A turma discutiu várias possibilidades de uso. Uma delas foi o levantamento bibliográfico: colocar artigos em uma pasta e pedir ao agente que abra cada um, faça resumos, selecione os mais relevantes e organize uma tabela. Outra possibilidade foi o tratamento de entrevistas: abrir áudios, enviá-los a uma ferramenta de transcrição, salvar os textos em uma pasta, revisar e organizar os arquivos.

Também apareceram exemplos administrativos, como abrir muitas planilhas de avaliação de curso, consolidar respostas, gerar gráficos e produzir relatórios. Outro exemplo citado foi o de uma colega que tinha milhares de PDFs e precisava extrair números de notas fiscais — tarefa repetitiva, cansativa e ideal para automação assistida.

A diferença em relação a ferramentas como NotebookLM foi esclarecida: no NotebookLM, o usuário precisa inserir os documentos; com um agente, em tese, seria possível pedir que ele abrisse uma pasta, selecionasse arquivos, enviasse para outro serviço, retornasse, salvasse resultados e encadeasse ações em vários ambientes.

14. Ambivalência: fascínio, medo e produtividade

A discussão com a turma revelou uma ambivalência importante: os agentes geram fascínio, mas também medo. Por um lado, podem economizar tempo e ajudar em tarefas repetitivas. Por outro, atravessam fronteiras sensíveis: acessar Drive, e-mail, arquivos pessoais, computador local.

Uma participante perguntou se esse tipo de recurso não estaria ligado à lógica da produtividade extrema: uma pessoa fazendo o trabalho que antes exigiria várias. Essa questão trouxe de volta o debate sobre produtivismo, automação e intensificação do trabalho.

A resposta foi que os usos são variados. Agentes podem servir a executivos, programadores e empresas, mas também podem ser ferramentas de acessibilidade para pessoas com dificuldades motoras, instrumentos de apoio a pesquisadores com grande volume de material ou auxiliares em tarefas administrativas repetitivas. O problema não é apenas a tecnologia em si, mas a cosmotécnica na qual ela é inserida: eficiência para quê? A serviço de quem? Com quais limites? Com qual supervisão?

15. IA, revisão bibliográfica e risco de alucinação

A aula retomou um ponto recorrente do curso: modelos de linguagem podem alucinar referências. Uma participante relatou ter pedido referências e revisões com base em critérios como PRISMA, mas encontrou artigos falsos, títulos trocados e autores confundidos. A recomendação foi usar ferramentas especializadas, como bases acadêmicas e plataformas voltadas à literatura científica, conectadas ou combinadas ao ChatGPT.

A ideia foi reforçada: o ChatGPT puro é muito bom para linguagem, organização, síntese e formulação, mas não deve ser usado sozinho como mecanismo confiável de busca bibliográfica. Para pesquisa acadêmica, é preciso combinar IA com bases reais, verificação manual e critérios metodológicos explícitos.

16. Produção acadêmica, excesso de artigos e responsabilidade

Outro debate importante foi o crescimento da produção acadêmica mediada por IA. Um participante observou que quem antes escrevia um artigo por ano agora pode tentar escrever cinco, muitas vezes com baixa qualidade. Isso cria pressão sobre revistas, pareceristas e editores, que não estão preparados para uma avalanche de textos produzidos rapidamente.

A aula conectou esse ponto à integridade acadêmica. O problema não é apenas usar IA, mas usar IA sem critério, sem transparência, sem domínio do campo e sem responsabilidade sobre o resultado. Também foi mencionado o fenômeno de “humanizar” textos para esconder o uso de IA, como tirar travessões ou alterar marcas estilísticas detectáveis.

A posição defendida na aula foi que o uso sério da IA exige mais trabalho, não menos. Usar bem IA significa construir contexto, revisar, comparar, pedir alternativas, checar fontes, avaliar argumentos e assumir responsabilidade. O problema está na “tentação do botão”: delegar rapidamente, com pouco contexto e pouca revisão, gerando textos genéricos, superficiais e possivelmente errados.

17. Estudantes, IA e cotutoria

No fechamento, a aula voltou ao tema educacional. Foi rejeitada a generalização de que estudantes jovens seriam simplesmente preguiçosos ou interessados apenas em delegar tarefas. Em experiências recentes com estudantes de computação e bacharelado interdisciplinar, alguns relataram usar IA como forma de serem provocados, estimulados e ajudados a aprender mais.

A aula retomou uma tipologia de estudantes: o estudante que mergulha na utopia acadêmica; o minimalista, que quer fazer apenas o necessário para passar; o estratégico, que performa a vida acadêmica como caminho profissional; e o perdido, que não sabe bem por que está ali. Essas categorias foram apresentadas como fluidas: um mesmo estudante pode ocupar posições diferentes em diferentes disciplinas ou momentos (Essa tipologia foi desenvolvida pelo sociólogo Saeed Paivandi).

Nesse contexto, a IA pode funcionar como cotutora. Não substitui o professor, a sala de aula ou a experiência pedagógica, mas pode oferecer acompanhamento personalizado. Foram mencionadas experiências como GPTs acadêmicos institucionais e tutores de matemática como o Khanmigo. A promessa é um apoio individualizado, disponível a qualquer hora, capaz de responder a dúvidas específicas e acompanhar ritmos distintos de aprendizagem.

18. Fechamento: uma perspectiva tropical para a IA

A última aula terminou retomando o sentido geral do curso: aprender a pesquisar com IA não é apenas aprender ferramentas. É construir uma relação crítica, situada e responsável com essas tecnologias. Isso envolve método, contexto, leitura, escrita, ética, integridade, supervisão, imaginação pedagógica e reflexão filosófica.

A ideia de uma cosmotécnica tropical ofereceu uma chave de fechamento: não se trata de rejeitar a IA, nem de adotá-la como destino inevitável. Trata-se de deglutir essas tecnologias, compreendê-las, adaptá-las, tensioná-las e reinscrevê-las em nossas práticas, territórios, problemas e formas de vida.

O curso foi encerrado com o convite para manter o grupo ativo, compartilhar materiais e preservar os links das gravações como conteúdo restrito da turma, já que os encontros incluíam falas e participações dos alunos. A experiência foi apresentada como abertura de janelas e caminhos para pensar uma relação mais crítica, criativa e situada com a IA na pesquisa acadêmica.

Ideias-chave da aula

- Pesquisar com IA continua exigindo método.

A IA muda o ambiente da pesquisa, mas não elimina delimitação, leitura, fichamento, comparação, verificação e responsabilidade. - Tecnologias não são apenas instrumentos.

Elas transformam formas de pensar, trabalhar, escrever, organizar o tempo e compor relações sociais. - A IA deve ser pensada conceitualmente.

A aula propôs sair da pergunta “como usar?” para incluir “que mundo essa técnica ajuda a produzir?”. - Cosmotécnica é uma chave para desuniversalizar a tecnologia.

Diferentes culturas pensam e praticam a técnica de modos distintos. Não há uma única história universal da tecnologia. - Uma cosmotécnica tropical pode aproximar IA, antropofagia, território e cultura digital brasileira.

- Agentes de IA apontam para uma nova etapa da automação.

Eles não apenas respondem, mas executam tarefas em aplicativos, arquivos e sistemas. - Agentes exigem segurança e supervisão.

O uso responsável passa por contas secundárias, ambientes isolados, permissões limitadas e revisão humana. - O risco principal não é a IA em si, mas a delegação sem contexto.

A “tentação do botão” produz superficialidade, alucinação e perda de responsabilidade intelectual. - A IA pode funcionar como cotutora.

Em contextos pedagógicos bem desenhados, pode apoiar ritmos diferentes de aprendizagem sem substituir o professor. - O desafio é político, pedagógico e cosmotécnico.

A questão não é apenas usar IA, mas decidir como integrá-la a formas de pesquisa mais críticas, plurais e responsáveis.

Deixe um comentário